È un prezioso insieme di tecniche, che aiutano giornalisti e ricercatori nelle aree di conflitto. Ma nelle mani sbagliate possono scatenare un tipo di disinformazione senza precedenti

Video, foto e immagini satellitari postate sui social media forniscono un’enorme quantità di dati, che possono aiutare organizzazioni e giornalisti a comprendere meglio quanto accade in un determinato territorio. L’Open Source Intelligence (OSINT) si basa su un’ampia gamma di fonti digitali aperte, su svariate serie di dati che possono essere combinati per ricreare un ambiente del passato, così da comprendere meglio cosa è accaduto in un luogo e in un momento specifico.

Quello che era nato come un passatempo da “nerd” è destinato a essere sempre più importante per il giornalismo investigativo e per il lavoro degli analisti nell’era digitale. Gruppi come Forensic Architecture e Bellingcat, organizzazioni indipendenti che conducono ricerche e indagini utilizzando la ricerca open source, hanno aperto la strada a nuovi modi creativi per arrivare alla verità attraverso le fonti digitali.

In contesti di crisi, come il conflitto tra Russia e Ucraina o l’escalation di violenza tra Israele e Hamas, questi strumenti si stanno rivelando sempre più determinanti per svelare la verità su alcuni fatti. Ma se non sono utilizzati con criterio e spirito critico, o se finiscono nelle mani sbagliate, rischiano di ribellarsi e diffondere disinformazione.

Definire l’OSINT

Alessandro Accorsi, Senior Analyst di social media e conflitti per Crisis group, un’organizzazione indipendente che lavora per prevenire le guerre e definire politiche che costruiscano un mondo più pacifico, ha spiegato a Facta.news che l’OSINT, in italiano tradotto con “intelligenza a fonti aperte”, «è l’utilizzo di informazioni disponibili e pubbliche, quindi che non hanno a che fare con agenzie di spionaggio, ma sono informazioni che possono essere trovate da qualsiasi cittadino e utente dei social media e che vengono analizzate per capire cosa sta succedendo in una particolare situazione». L’esempio classico, ha aggiunto Accorsi, «è quello di foto o video che compaiono sui social media dopo un incidente o in altre circostanze e attraverso la geolocalizzazione di queste foto è possibile verificare che effettivamente si tratti di un posto ben specifico, la verifica del giorno, dell’ora e del mese in cui l’evento è successo».

Secondo la definizione data dalla Commissione Europea, le fonti aperte che fanno parte dell’OSINT possono essere suddivise in sei categorie: media pubblici, Internet – cioè pubblicazioni e blog online, gruppi di discussione come forum e siti Web, social media –, dati pubblici governativi, pubblicazioni professionali e accademiche, dati commerciali e letteratura grigia (definizione che comprende relazioni tecniche, brevetti, documenti aziendali, lavori inediti e newsletter).

Si tratta, quindi, di strumenti accessibili a tutti, nel senso che sono contenuti che circolano pubblicamente sui social media o su altre piattaforme e a cui, potenzialmente, ciascuno di noi può essere esposto. Analizzarle, però, è un altro conto. Alessandro Accorsi ha, infatti, chiarito che «vedere da un’immagine la direzione dell’ombra lasciata dall’albero per capire in che periodo dell’anno e a che ora del giorno sia stata scattata quella foto non è altrettanto semplice, ma è una cosa che con del training si può fare».

Il rapporto del giornalismo con l’OSINT

Questa tecnica sta gradualmente guadagnando il rispetto di alcune delle più prestigiose redazioni giornalistiche al mondo, ma potrà mai sostituire il giornalismo sul campo? La risposta è no, l’OSINT non sostituisce ma integra il giornalismo che si nutre di fonti in carne ed ossa e di dati raccolti direttamente sugli scenari di guerra.

L’utilizzo delle fonti aperte «è cresciuto perché in alcuni conflitti, come in Ucraina o a Gaza, non c’è la possibilità di accedere veramente al terreno» ha spiegato Accorsi, «i media tradizionali sono quindi costretti a utilizzare fonti ufficiali del governo israeliano o legate ad Hamas, o a fare affidamento sui giornalisti palestinesi che sono sul campo, che fanno un lavoro enorme, ma rischiano costantemente la vita». Ricordiamo infatti che tra il 7 ottobre e il 2 novembre sono stati uccisi più di 30 giornalisti e operatori dei media nelle violenze tra Israele e Hamas e qui trovate una lista di tutti i loro nomi, purtroppo in costante aggiornamento.

In contesti di questo tipo, quando l’accesso al campo è limitato, giornalisti e ricercatori possono utilizzare le fonti aperte per ottenere alcune risposte, anche se questi strumenti da soli non danno sempre certezze assolute, perché in molti casi mancano degli elementi fondamentali per individuare la pistola fumante.

Inoltre, come ha spiegato Accorsi a Facta.news, «i media tradizionali hanno avuto un approccio ambivalente verso l’OSINT». Alcune redazioni negli ultimi anni si sono dotate di quelli che vengono chiamati visual investigation team. Si tratta di gruppi di esperti che combinano il giornalismo tradizionale con l’indagine digitale e l’analisi forense delle prove visive per verificare e decostruire importanti eventi di cronaca, cercando di arrivare alla verità. È il caso per esempio del New York Times, del Washington Post o del Financial Times, che hanno costituito team di professionisti che utilizzano l’OSINT per verificare notizie poco accessibili di persona.

Alessandro Accorsi, però, ha sottolineato che accanto a redazioni che si sono dotate di questi gruppi, ci sono tante altre realtà che non hanno la capacità interna di utilizzare fonti di questo tipo, «ma devono appoggiarsi a esperti esterni, spesso innescando un cortocircuito». Ciò accade prevalentemente perché queste testate si servono del lavoro che vari professionisti dell’OSINT condividono sui social, senza pagarlo e in alcuni casi senza nemmeno verificare se si tratti realmente di persone qualificate.

È proprio quest’ultimo dettaglio che, in molti casi, lega l’analisi delle fonti aperte alla disinformazione.

Fonti aperte, piattaforme social e disinformazione

«Io mi occupo di Medio Oriente, in particolare Israele e Palestina, da almeno 18 anni. Mi occupo di social media e disinformazione da almeno 7 anni e non ho mai visto qualcosa del genere. La quantità di disinformazione che circola in questo momento è impressionante» ha spiegato l’analista di Crisis Group. Accorsi ha aggiunto inoltre che questo, dal suo punto di vista, è dovuto alle informazioni false o fuori contesto, alle teorie cospiratorie, o alle notizie che tentano di polarizzare le opinioni, ma ciò che è inquietante è «il modo in cui gli stessi strumenti che siamo costretti a utilizzare per cercare di capire i fatti, invece vengano weaponized, cioè vengono utilizzati per distruggere la verità stessa».

«Siamo arrivati a questa situazione in primo luogo perché negli ultimi anni c’è stato un degrado delle policy da parte delle piattaforme social» ha chiarito il ricercatore, aggiungendo che a partire dal caso Cambridge Analytica – scandalo politico avvenuti all’inizio del 2018, quando si scoprì che la società di consulenza britannica Cambridge Analytica aveva raccolto i dati personali di 87 milioni di account Facebook senza il loro consenso e li aveva usati per scopi di propaganda politica – c’è stata la tendenza a ridurre sempre di più la trasparenza rispetto a quanto avviene sui social media e l’accesso ai dati delle piattaforme. «Meta, per esempio, che controlla Facebook e Instagram», ha continuato Accorsi, «dà veramente pochissimo accesso a ricercatori esterni e ad altri per controllare quello che effettivamente succede sulla piattaforma» e quali siano le policy e gli investimenti che vengono implementati.

Come avevamo spiegato su Facta.news in un recente approfondimento, per esempio, Meta era stata accusata di mettere in shadow ban, cioè di oscurare, molti contenuti e account che riguardavano le violenze tra Israele e Hamas. Nonostante Meta abbia dichiarato di aver limitato la visibilità di alcuni post «per evitare che contenuti borderline che incitano all’odio o sono considerati violenti ricevano più engagement», le politiche adottate dalla piattaforma non sono del tutto chiare.

Ancora una volta X è la fonte aperta della disinformazione

Nemmeno X è esente dalle critiche. Il social network, anzi, è da tempo al centro delle polemiche per essere diventato il paradiso di estremisti, complottisti e antisemiti.

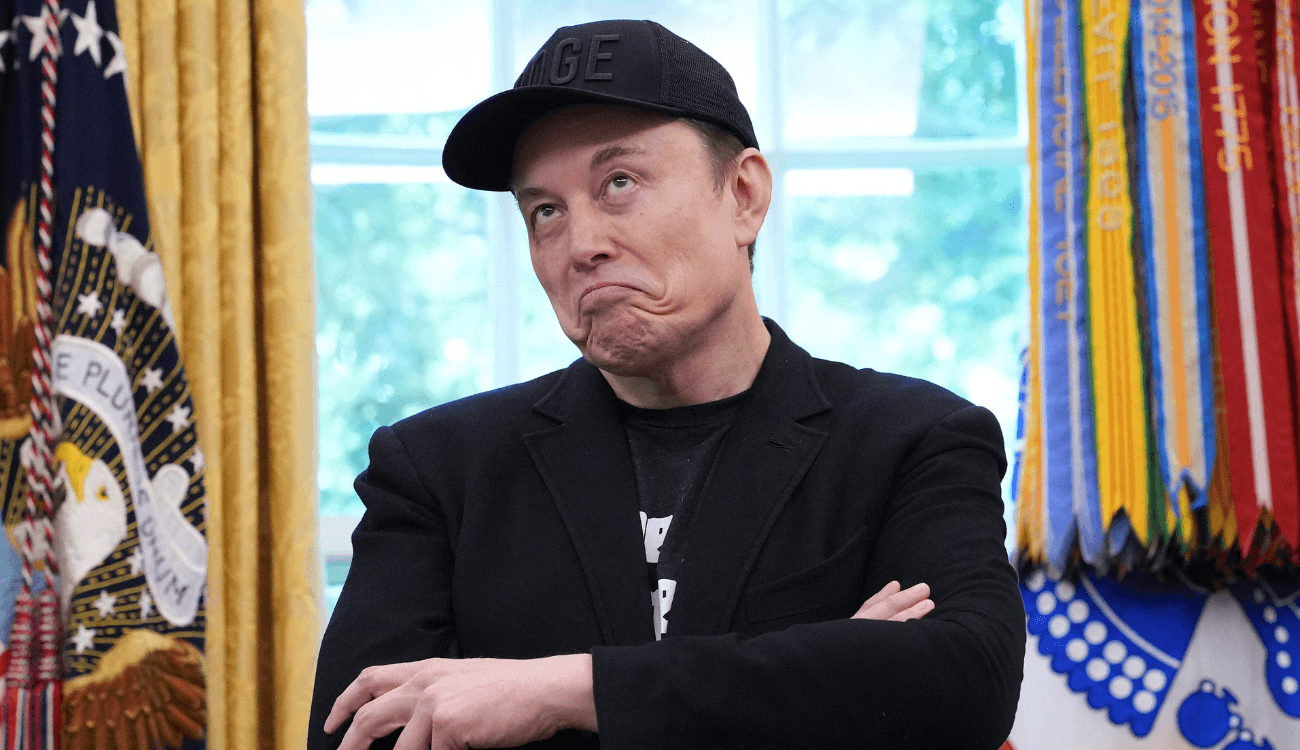

Se il fu Twitter era stato per anni la piattaforma utilizzata dalla maggior parte di giornalisti e ricercatori per ottenere informazioni aggiornate, accessibili e di prima mano sugli eventi che si verificavano nel mondo, da un anno a questa parte la stessa piattaforma è stata completamente stravolta. Non è solo il nome ad essere cambiato, ma Accorsi ha chiarito che «Twitter prima era una piattaforma che dimostrava di essere attenta alla trasparenza, all’accessibilità ai propri dati da parte dei ricercatori e alla moderazione. Ora, invece, questo modello è stato completamente distrutto».

Da quando Elon Musk è diventato capo della compagnia, circa un anno fa, ha innanzitutto licenziato interi team che si occupavano di moderazione dei contenuti e di fact-checking e che controllavano il funzionamento dell’algoritmo. L’imprenditore ha quindi accolto una delle funzioni che esistevano già prima del suo acquisto e ha sostituito questi gruppi di persone che sorvegliavano la piattaforma con le Community Notes, cioè una sorta di fact-checking dal basso che si regge sulla collaborazione degli utenti iscritti alla piattaforma e che consente ad alcuni di questi di aggiungere un contesto ai tweet che considerano fuorvianti. Si tratta di uno strumento che fatica a tenere il passo con il flusso di contenuti pubblicati sul social network e che non è in grado di contribuire a frenare del tutto notizie false e fuori contesto.

Il 29 ottobre 2023 Elon Musk ha annunciato che non sarà più possibile monetizzare attraverso contenuti che vengono controllati dalle Community Notes. «Ci sono dei problemi però» ha spiegato Accorsi, prima di tutto perché quei contenuti rimangono comunque online e quando appaiono le Community Notes sono già stati visti da milioni di persone.

È il caso, per esempio, di un tweet pubblicato il 28 ottobre da un influencer di destra americano, in cui si legge che un’indagine del quotidiano israeliano Haaretz dimostrerebbe che Israele avrebbe esagerato il numero delle vittime causate dall’attacco di Hamas. Questo contenuto è stato visualizzato più di cinque milioni di volte. La Community Note che precisa che si tratta di un contenuto falso è visibile, ma il tweet continua a circolare e, secondo Accorsi, «il copia-incolla di quel testo è apparso svariati milioni di volte, ma sotto quel tipo di contenuto non sono comparse le Community Notes». Ciò che, però, è ancora più descrittivo della situazione in cui si trova X è che il tweet che riporta il debunking di Haaretz, in cui viene chiarito che la presunta inchiesta citata nel tweet dell’influencer americano non esiste, è stato visto da poco più di un milione di utenti. Circa quattro volte in meno rispetto al post che riporta il contenuto di disinformazione.

I falsi profili OSINT su X

«Oltre a tutto ciò» ha aggiunto il ricercatore di Crisis Group, «l’accesso ai ricercatori indipendenti è stato tagliato, per cui non possiamo neanche verificare indipendentemente se quello che X fa e dice di fare effettivamente succede oppure no». Secondo Accorsi esistono palesi casi di disinformazione, ma le difese di X per prevenire questo fenomeno sono veramente basse. Anzi in molti casi è la stessa piattaforma a promuovere tali contenuti.

Le responsabilità di X nell’incentivare la disinformazione derivano principalmente dal fatto che in passato la spunta blu presente su alcuni profili dimostrava che l’account era stato verificato dal social media e quindi era autentico. Dopo l’acquisto della piattaforma da parte di Musk, la spunta blu può essere acquistata attraverso un abbonamento. Questo nuovo status di “utente premium” porta una serie di vantaggi tra cui il fatto che, pagando, i tweet di quell’utente possano essere visti da più persone.

In questo modo si è arrivati alla situazione in cui ci sono degli utenti che pagando possono diffondere informazioni false o fuori contesto, polarizzanti e rischiose. In questo contesto caotico, infatti, si sono diffusi profili con la spunta blu che si spacciano per esperti di OSINT, come quelli che aveva consigliato di seguire Elon Musk all’inizio dell’escalation di violenza tra Israele e Palestina, ma che in realtà diffondono disinformazione. Questi account secondo Accorsi «arrecano un danno enorme alla credibilità di organizzazioni indipendenti che effettivamente fanno il loro lavoro e che aiutano ricercatori, giornalisti, e altri operatori a capire quello che succede».

Le fonti aperte, quindi, sono uno strumento molto prezioso sia per il giornalismo sia per la ricerca, ma devono essere utilizzate in maniera consapevole e, soprattutto, critica per evitare di ottenere il risultato inverso e diffondere disinformazione, anziché combatterla.