Non crediamo davvero a tutto quello che pubblichiamo sui social

Nella selezione degli argomenti pesano altri fattori, come il desiderio di attrarre follower o la volontà di posizionarsi su alcuni temi

La disinformazione sui social media è diventata un fenomeno sempre più preoccupante nell’era digitale. Con la rapidità e la facilità con cui le informazioni possono essere condivise online, notizie false, teorie del complotto e contenuti manipolati si diffondono velocemente, influenzando l’opinione pubblica e alimentando confusione e divisioni nella società. Sono tuttavia molte le questioni ancora aperte sulle dinamiche di diffusione della disinformazione sui social media.

Gli esperti, ad esempio, si chiedono spesso come notizie tanto assurde e infondate riescano a diffondersi così facilmente tra gli utenti. Prendiamo il caso del Pizzagate, fra le teorie del complotto più note degli ultimi anni. La teoria del Pizzagate sosteneva, senza prove, che una pizzeria di Washington D.C., il Comet Ping Pong, fosse al centro di un traffico di minori gestito da esponenti satanisti del Partito Democratico, tra cui Hillary Clinton. La teoria, diffusa nel 2016 attraverso social media e forum, si basava su un’interpretazione fantasiosa delle email di John Podesta, il responsabile della campagna elettorale di Clinton, pubblicate da WikiLeaks nell’ottobre di quell’anno. Nonostante l’assenza di prove, la teoria si è rapidamente propagata sui social, fino a convincere un uomo di nome Edgar Welch a fare irruzione armato nel Comet Ping Pong per “indagare” sulla vicenda.

Per avere un’idea della diffusione del Pizzagate, il New York Times ha ricavato i dati delle interazioni con i post a tema Pizzagate di Facebook e Instagram da CrowdTangle – un tool di Meta ora non più disponibile. Nella prima settimana di dicembre 2016, i post sul Pizzagate hanno ottenuto circa 512mila interazioni su Facebook e 93mila su Instagram. Questi numeri accorpano insieme le menzioni, i like e le condivisioni dei post, e quindi potrebbero sembrare piccoli in valore assoluto. Tuttavia vanno contestualizzati. I dati di CrowdTangle si riferiscono infatti a interazioni avvenute sui social otto anni fa, un arco di tempo enorme considerando la velocità di evoluzione dei social media. Paragonare questi numeri a quelli di un qualsiasi contenuto virale del 2024 sarebbe quindi fuorviante. I dati sulle interazioni del Pizzagate sono invece elevati, soprattutto se si considera il periodo in cui sono stati raccolti e l’assurdità della teoria in questione.

La teoria ha poi ripreso piede su TikTok nell’estate del 2020, poco prima delle nuove elezioni presidenziali statunitensi, facendo lievitare di nuovo le interazioni sui social di Meta. Nella prima settimana di giugno le nuove interazioni su Facebook erano state più di 800mila, mentre su Instagram circa 600mila. Come è possibile che una teoria del genere abbia riscosso tanto successo? Davvero centinaia di migliaia di utenti si sono lasciati convincere dalla storia di Hillary Clinton a capo di una setta pedofila con base segreta in una pizzeria di Washington?

Condividere non significa credere

Questa domanda in realtà è viziata da un problema di fondo. Spesso infatti pensiamo che ci sia un nesso ovvio fra la ricondivisione di un contenuto sui social, come una notizia, e la credenza in quello stesso contenuto. In altre parole, diamo per scontato che un utente prenda per vero tutto quello che sta condividendo dal proprio feed, e di conseguenza interpretiamo l’ampia circolazione di un contenuto come prova che questo abbia persuaso un numero molto grande di persone. D’altra parte sembra lecito pensare che credere a un contenuto e ricondividerlo sui social siano due cose strettamente legate: se uno non pensa che una notizia sia quantomeno plausibile, perché dovrebbe condividerla? In realtà le cose non stanno proprio così.

Alcune evidenze sperimentali indicano che i giudizi sull’accuratezza di un contenuto hanno poco peso sulle intenzioni di ricondivisione degli utenti. Detto altrimenti, quando un utente deve decidere se ricondividere un post spesso non lo fa sulla base di quanto sia vero quel contenuto, ma soppesa altri fattori; ad esempio il desiderio di accontentare e/o attrarre follower e la volontà di segnalare la propria appartenenza a un gruppo sociale o politico.

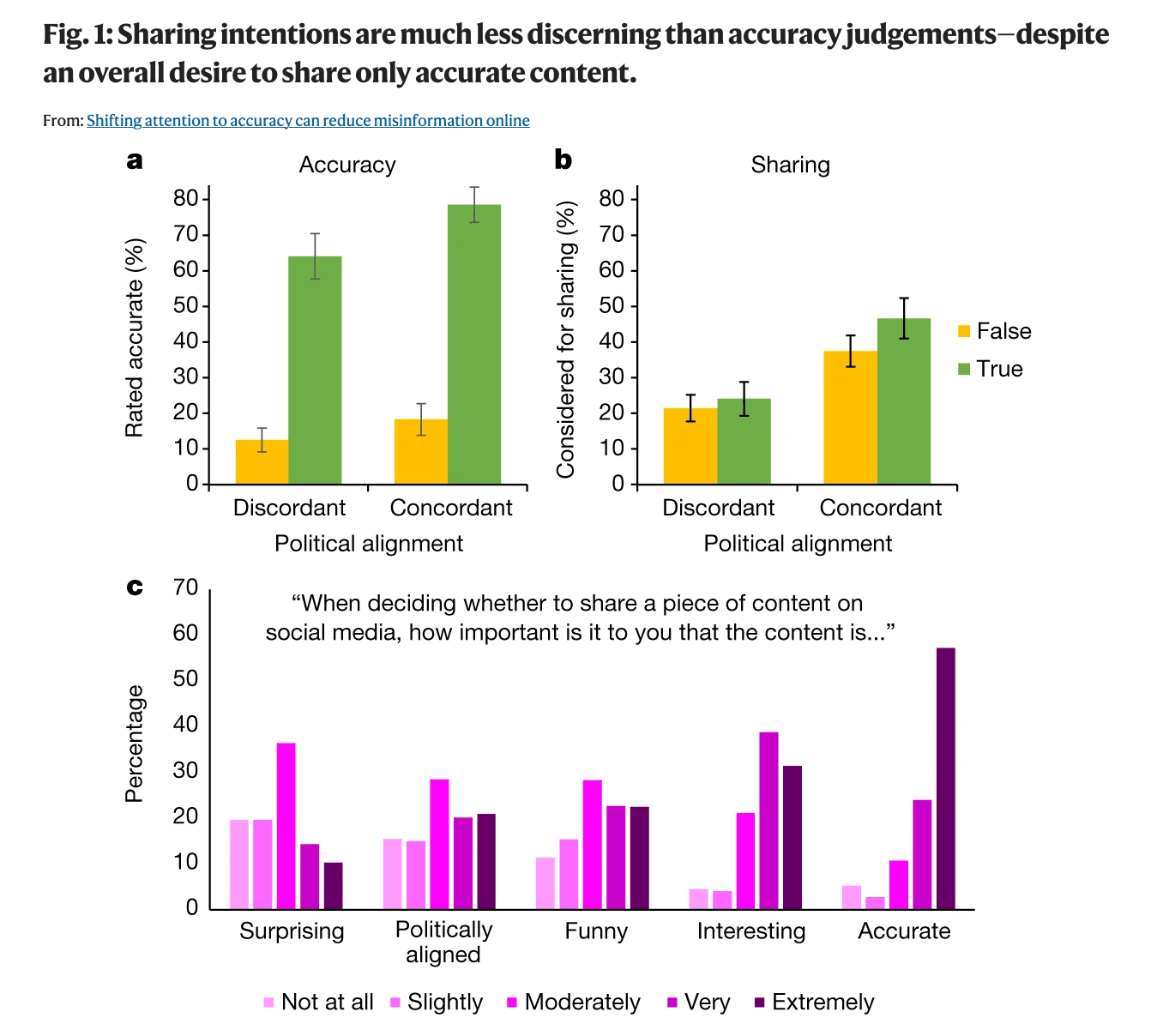

In uno studio del 2021, il team di Gordon Pennycook, professore di psicologia alla Cornell University (New York), ha reclutato circa mille partecipanti da Amazon Mechanical Turk – una piattaforma di crowdsourcing di Amazon in cui un utente, il requester, può reclutare dei lavoratori per svolgere delle mansioni a distanza, di solito piccole task di inserimento dati. Nel corso dell’esperimento, ai partecipanti è stato presentato il titolo, la frase iniziale e l’immagine di 36 notizie prese dai social media. Metà dei titoli erano completamente falsi e l’altra metà veri; inoltre, metà dei titoli erano stati scelti per essere favorevoli ai Democratici e l’altra metà ai Repubblicani. Ogni partecipante è stato quindi assegnato casualmente a una sola fra due condizioni sperimentali. In una, il partecipante aveva il compito di valutare con un voto la veridicità di ogni titolo. Nell’altra invece, per ogni titolo, doveva dichiarare se sarebbe stato disposto a ricondividerlo sul proprio profilo social oppure no.

I risultati dei voti nella prima condizione ci dicono che i titoli veri sono stati valutati come accurati molto più spesso dei titoli falsi – in media di circa 60 punti percentuali in più nella scala di accuratezza. C’è stato un piccolo effetto d’influenza dovuto all’appartenenza politica: i partecipanti hanno valutato come più accurati i titoli che si allineavano con il loro orientamento politico rispetto a quelli che vi si discordavano. Ma questo effetto non è stato poi tanto grande, perché i titoli veri e politicamente concordanti sono stati comunque valutati come più accurati dei titoli falsi della stessa categoria.

Se invece andiamo a guardare i risultati sulle intenzioni di ricondivisione otteniamo il risultato opposto. Il fatto che il titolo fosse politicamente concordante o discordante ha avuto un impatto significativamente maggiore sulle intenzioni di condivisione rispetto al fatto che il titolo fosse vero o falso. Infatti, se il titolo di giornale si allineava con l’orientamento politico del partecipante, c’era in media il 19 per cento di probabilità in più che questi lo prendesse in considerazione per una condivisione rispetto a un titolo politicamente discordante. Invece, se la scelta di ricondivisione doveva basarsi sul grado di verità del titolo, c’era solo il 6 per cento di probabilità in più che il partecipante condividesse un titolo perché vero. In sintesi, quando chiamati a decidere se ricondivere o meno un contenuto, i partecipanti hanno preferito dare più peso al grado di affinità politica del titolo, piuttosto che alla sua accuratezza.

Ciò significa che i partecipanti dello studio del team di Pennycook avrebbero tranquillamente ricondiviso un contenuto che a mente fredda giudicavano falso; nonostante nella fase finale dello studio quasi tutti dichiarassero che l’accuratezza fosse estremamente importante per la condivisione di un titolo di giornale, e ben più rilevante di altri fattori come il livello di interesse per il contenuto, il divertimento e lo stupore suscitati, e persino dello stesso grado di allineamento politico. Si tratta di un dato interessante, che Pennycook e il suo team hanno utilizzato per corroborare la loro tesi sul perché la gente ricondivide disinformazione. La loro idea è che l’accuratezza di un contenuto giochi un ruolo marginale nella scelta di ricondivisione, anche se a parole gli utenti dichiarano il contrario; e questo perché il contesto dei social media sposta inevitabilmente la loro attenzione su altri fattori, già citati in precedenza: il desiderio di gratificazione e la volontà di sentirsi parte di un gruppo politico o sociale.

Affinità politica o accuratezza

La tesi di Pennycook e colleghi – ribattezzata “modello della disattenzione” – non è ovviamente l’unica in letteratura. Un altro modello, detto “delle preferenze”, sposa l’idea che gli utenti preferiscono privilegiare la propria identità politica sui social e quindi, se necessario, condividono consapevolmente dei contenuti falsi (mentre nel modello di Pennycook gli utenti dichiarano di preferire l’accuratezza, e condividono disinformazione per disattenzione). Un lavoro di Jay Van Baivel e Andrea Pereira del 2018 espone molto bene le tesi sottostanti al modello delle preferenze.

Secondo i due studiosi, l’appartenenza politica può influenzare le decisioni dei soggetti in due modi. Stando a una prima ipotesi, essa può fungere da euristica, ovvero da scorciatoia mentale: le persone utilizzano le posizioni e gli atteggiamenti espressi dal proprio gruppo politico di riferimento come guida per le proprie scelte (es. “se il mio partito la pensa così allora è la cosa giusta”). Una seconda ipotesi, invece, è che l’influenza sia solo a livello di ragionamento. In questo secondo caso, il soggetto si limita ad appoggiare la posizione del partito al solo scopo di beneficiarne socialmente, ad esempio per ricevere l’approvazione dei suoi compagni di partito.

Al di là del modello teorico che si intende privilegiare, una cosa è certa: gli utenti non credono necessariamente a quello che ricondividono sui social, e quindi la disinformazione può girare per motivazioni diverse dalla semplice credenza. Quando non è affermazione del proprio credo politico o un tentativo di gratificazione, può anche trattarsi di trolling. Le interpretazioni di una ricondivisione sono molteplici perché in fin dei conti, come sostiene la filosofa Regina Rini, è la stessa comunicazione dei social a essere ambigua. Questo perché non esistono, o non esistono ancora, delle norme sociali che stabiliscono una volta per tutte cosa sta comunicando una persona che condivide un contenuto sui social. Se contestato per aver ricondiviso disinformazione, l’utente infatti potrà sempre difendersi invocando questa ambiguità di fondo.

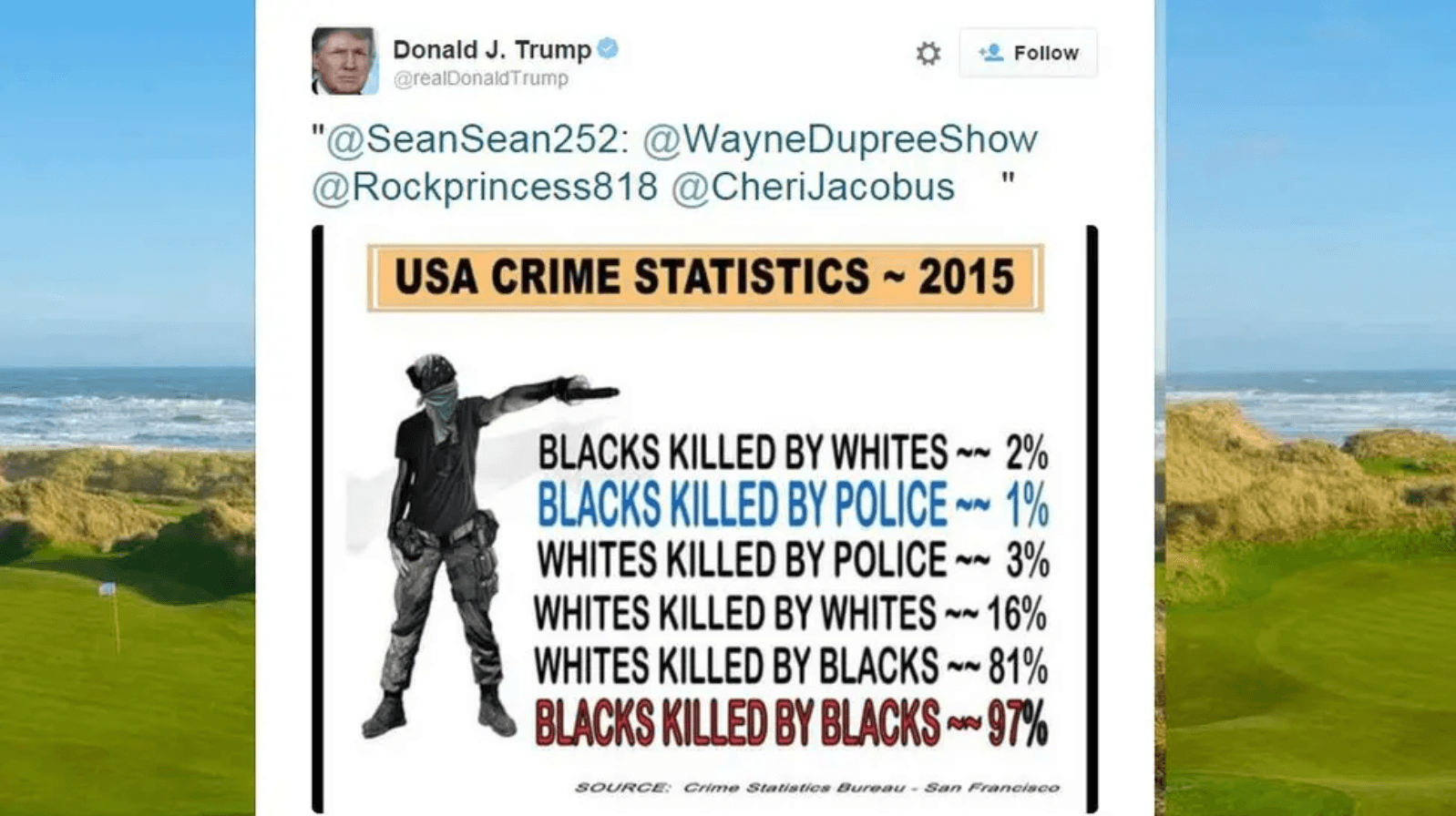

A titolo di esempio, Rini ricorda un episodio del novembre 2015. All’epoca Donald Trump pubblicò sul suo account Twitter (ora X) un’infografica piena di statistiche fasulle. Una di queste riportava che l’81 per cento delle vittime bianche di omicidio negli Stati Uniti venivano uccise da afroamericani, ma la percentuale corretta era del 14,7 per cento (qui i dati del FBI del 2014).

Quando Bill O’Reilly, opinionista di Fox News, ha chiesto all’ex presidente di dare conto di quella falsa percentuale, Trump si è difeso dicendo che era «solo un retweet» e che lui non sente il dovere di controllare ogni statistica che gli passa sotto mano. Questa difesa, che Trump ha poi rispolverato per molti altri tweet dimostrabilmente falsi, è per Rini un esempio di come la comunicazione sui social media sia regolata da norme controverse, che consentono agli utenti di sollevarsi dalla responsabilità di aver diffuso consapevolmente un contenuto falso. Col risultato che le notizie assurde, in stile Pizzagate, circolano ancora più facilmente.

- Questa immagine non rappresenta correttamente la dinamica dell’uccisione di Renee Nicole GoodQuesta immagine non rappresenta correttamente la dinamica dell’uccisione di Renee Nicole Good

- No, Meloni non ha promesso di lasciare la politica se perderà “il referendum sulla magistratura”No, Meloni non ha promesso di lasciare la politica se perderà “il referendum sulla magistratura”